„Ich bin recht zuversichtlich“

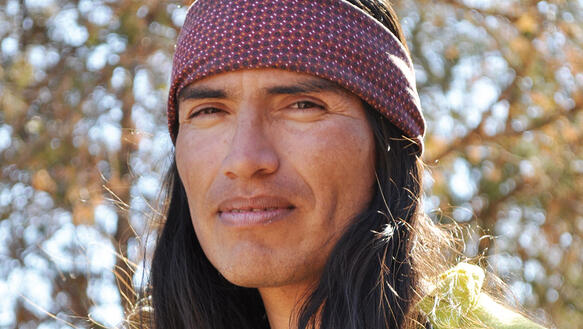

Der Einsatz von Gesichtserkennungstechnologie zur Massenüberwachung nimmt Menschen die Möglichkeit, sich frei im öffentlichen Raum zu bewegen.

© IMAGO / imagebroker

Inwiefern gefährdet Künstliche Intelligenz die Menschenrechte? Die Medienethikerin Jessica Heesen über Risiken und Regulierungsversuche.

Interview: Tobias Oellig

Inwiefern kann der Einsatz von Künstlicher Intelligenz (KI) für die Menschenrechte problematisch werden?

Grundlegend werden Würde und Selbstbestimmung des Menschen in Frage gestellt, wenn KI-gesteuerte Systeme Entscheidungen über Menschen fällen – zum Beispiel in der Personalauswahl oder für den Bezug von Sozialleistungen. Bei vielen Anwendungen gibt es ein Diskriminierungspotenzial für Menschengruppen, die bereits jetzt gesellschaftlich marginalisiert sind oder ungerecht behandelt werden. KI reproduziert hier häufig Muster, die in der Gesellschaft vorherrschen. Oder sie wird für Anwendungen genutzt, die generell nicht mit unseren Vorstellungen von Menschenrechten übereinstimmen: Lügendetektoren an den Grenzen, biometrische Überwachungsverfahren oder Bewertungssysteme für Menschen (Social Scoring).

Der UN-Menschenrechtsrat hat kürzlich eine Resolution zu Schutz- und Kontrollmaßnahmen verabschiedet, die insbesondere Transparenz fordert. Wird das etwas nützen?

Weltweit liegen inzwischen Hunderte Resolutionen und Ethikrichtlinien zum Umgang mit KI vor, die alle die Forderung nach Transparenz beinhalten. Dazu sind zwei Dinge zu sagen: Erstens, wir haben keinen Mangel an richtigen Forderungen zur Steuerung der Entwicklung von KI. Politik, Unternehmen und Forschung müssen nun aber zu einer schnellen und effizienten Umsetzung kommen. Zweitens geht es nicht nur um Transparenz, sondern um Verständlichkeit und Nachvollziehbarkeit. Bei der Regulierung von KI geht es nicht darum, ob jede einzelne Person nachvollziehen kann, wie KI technisch funktioniert, sondern um allgemeine Standards und Regeln für ihre Verwendung, die die Bürgerinnen und Bürger schützen und für eine verlässliche und vertrauenswürdige KI-Nutzung sorgen.

Kann die vom Europaparlament verabschiedete KI-Verordnung ein entscheidender Beitrag für eine verbesserte Regulierung sein?

Da bin ich recht zuversichtlich. Die EU schafft einen Rahmen, der voraussichtlich eine einschneidende Wirkung auf die Verringerung der Risiken von KI haben wird – insbesondere auch für menschenrechtlich relevante Aspekte wie Chancengleichheit oder Selbstbestimmung.

Jessica Heesen forscht zu Medienethik, Technikphilosophie und KI an der Universität Tübingen.

© privat

Welche ethischen Werte sollten bei der Entwicklung von KI Beachtung finden?

Die ethischen Standards lauten Transparenz und Verständlichkeit, Wahrung der menschlichen Aufsicht und des Datenschutzes, Diskriminierungsfreiheit, Verlässlichkeit der Systeme und Sicherstellung der Rechenschaftspflicht. Das ist alles bekannt, und diesen Zielen widerspricht so gut wie niemand. Wie so häufig bei ethischen Werten entstehen Konflikte und praktische Herausforderungen, wenn es um die Umsetzung geht.

Gibt es Fälle, in denen KI vorbildlich reguliert wird?

Es gibt einzelne Städte, die mit KI und algorithmischen Entscheidungssystemen ziemlich vorbildlich umgehen. Amsterdam und Kopenhagen führen Transparenzregister und erklären, wie und zu welchen Zwecken sie Anwendungen für die Stadtverwaltung nutzen.

Lässt sich technisch überprüfen, ob ein Algorithmus in seinen komplexen Verästelungen nicht doch diskriminiert?

Man kann recht gut kontrollieren, ob Algorithmen diskriminieren. Dazu muss man nicht jeden Schritt im Lernen des KI-Systems im Detail nachvollziehen können. Stattdessen ist die Qualität der Trainingsdaten sehr wichtig. Sind die Daten repräsentativ und vollständig? Bauen sich über bestimmte Daten eventuell indirekte Formen der Diskriminierung auf? Auch wenn aus Gründen der Diskriminierungsfreiheit zum Beispiel keine Daten über die ethnische Zugehörigkeit erhoben werden, können sich diskriminierende Muster über Angaben zur Wohngegend oder zur Schulausbildung einschleichen. Die Datenqualität bestimmt stark, wie KI-Systeme zu einem Ergebnis kommen. Genauso können die Algorithmen, also die Regeln zur Bearbeitung der Daten, geprüft werden, und auch die Resultate können systematisch verglichen und auf diskriminierende Faktoren hin kontrolliert werden. Dazu muss nicht jedes Unternehmen oder jede Behörde eine spezialisierte Diskriminierungsbeauftragte haben. Das Ziel ist, KI-Anwendungen nach bestimmten Standards zu entwickeln und Zertifikate zu vergeben, an denen Nutzerinnen und Nutzer sich orientieren können.

Was ist Ihre positive Vision von einem gemeinwohlorientierten, nachhaltigen Umgang mit KI?

Ich habe keine konkrete Anwendung vor Augen, aber Vorstellungen davon, welche Haltung die Gesellschaft zu KI entwickeln sollte. KI ist eine Technik, die Menschen mit bestimmten Motivationen herstellen und nutzen. Es ist also immer zu fragen, wer profitiert von einer Anwendung und wer nicht? Was sind die Zwecke? Sind sie gerechtfertigt? Um einen aufgeklärten und kritischen Umgang mit KI zu entwickeln, ist es wichtig, dass KI-Anwendungen nicht menschenähnlich gestaltet werden, sondern ihr technischer Charakter jederzeit bewusst bleibt. Hierfür sind Kennzeichnungspflichten wichtig. Natürlich muss stets die menschliche Aufsicht gewahrt bleiben, und möglichst viele Menschen sollten an den Vorteilen der KI teilhaben können, um letztlich die Entwicklungschancen für gemeinwohlorientierte KI-Anwendungen zu erhöhen.

Jessica Heesen ist Leiterin des Forschungsschwerpunkts Medienethik, Technikphilosophie & KI am Ethikzentrum der Universität Tübingen.