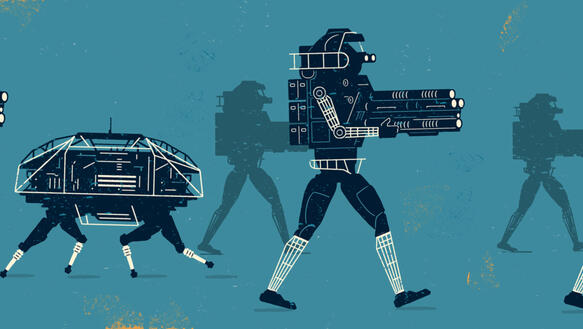

Menschen töten ohne Menschen

In der Flugabwehr sind nahezu autonome Systeme bereits im Einsatz

© Jens Bonnke

Autonome Waffensysteme revolutionieren die Kriegsführung. Nur ein Verbot kann verhindern, dass Menschen als Entscheidungsträger wegfallen.

Von Mathias John

Galten sie vor kurzem noch als Erfindungen aus Science-Fiction-Filmen, rücken tödliche autonome Waffensysteme zu Land, zu Wasser und in der Luft immer näher. Denn Fortschritte bei der künstlichen Intelligenz im zivilen Bereich treiben auch die militärische Entwicklung voran: Diese hat zum Ziel, eine menschliche Waffensteuerung durch autonome Systeme zu ersetzen. Erste Waffensysteme mit weitgehender Autonomie sind in der Flugabwehr bereits im Einsatz. Weit fortgeschritten ist zudem die Entwicklung von autonomen Drohnen und von Bodenfahrzeugen für Polizei oder Militär mit Überwachungstechnik, aber auch von sogenannten nicht-tödlichen Waffen wie Tränengas oder Gummigeschossen.

Amnesty International und andere Nichtregierungsorganisationen fordern ein vorsorgliches Verbot autonomer Waffensysteme, bevor weiter Fakten geschaffen werden. Selbst Manager aus Unternehmen im Bereich Robotik und künstlicher Intelligenz warnen vor einem Wettrüsten bei autonomen tödlichen (Lethal autonomous weapons systems, LAWS) und weniger tödlichen (Less lethal autonomous weapons systems, LLAWS) Waffensystemen. Sie sind längst nicht mehr nur Gegenstand von Forschung und Entwicklung, sondern auch von rechtlichen und militärtaktischen Diskussionen.

Angesichts der rasanten technischen Entwicklungen verläuft die diplomatische Auseinandersetzung um die Regulierung und Kontrolle dieser Systeme jedoch erschreckend zäh. Sie wird derzeit vor allem im Rahmen der UN-Konvention über bestimmte konventionelle Waffen (Convention on Certain Conventional Weapons, CCW) geführt. Zwar gibt es nach Jahren informeller Beratungen endlich eine formelle Gruppe bei der CCW, aber deren erstes Treffen 2017 brachte kaum Ergebnisse. Hier muss endlich eine substanzielle Diskussion beginnen.

Die Mühen auf der diplomatischen Ebene beginnen schon bei der Definition autonomer Waffensysteme sowie deren rechtlicher und ethischer Bewertung. Denn sie sind anders als herkömmliche bewaffnete Drohnen. Diese enthalten zwar semi-autonome Technik und können selbstständig ein Zielgebiet anfliegen, bleiben aber doch von Menschen gelenkt, die den Waffeneinsatz steuern.

Von Menschen gesteuerte Drohneneinsätze müssen deshalb das humanitäre Völkerrecht einhalten und bei der Wahl ihrer Ziele zwischen Zivilbevölkerung und Kombattanten unterscheiden, willkürliche und unterschiedslose Angriffe sowie Kollateralschäden vermeiden und den Schutz von Zivilisten und zivilen Objekten sicherstellen. Verstoßen die für einen Einsatz verantwortlichen Menschen gegen diese rechtlichen Verpflichtungen, können sie grundsätzlich zur Verantwortung gezogen werden.

Anders ist es bei autonomen Waffensystemen, die grundsätzlich dazu dienen sollen, eigenständig zu überwachen und als feindlich erkannte Geschosse, Fahrzeuge und Menschen selbstständig auszuschalten. Bereits im Einsatz sind Systeme, deren autonome Aktivitäten noch durch menschliches Eingreifen gesteuert werden können. Ein Angriff wird durch einen Menschen ausgelöst, nachdem das System eine Bedrohung erkannt hat.

Die weitgehende Kontrolle wie bei herkömmlichen Drohnen entfällt, doch gibt es noch eine menschliche Entscheidungsoption, die von der Lagebewertung und dem Angebot der Ziele durch das technische Assistenzsystem abhängig ist. Der Fachbegriff dafür lautet human-in-the-loop: Der Mensch in der Schleife wählt aus, was das System bekämpft. Im autonomen Waffensystem hingegen wird der Mensch völlig aus dem Entscheidungsprozess entfernt: human-out-of-the-loop. Die Maschine erfasst und bewertet die Lage, identifiziert mögliche Ziele und entscheidet selbstständig über den tödlichen Waffeneinsatz.

Menschenrechtsorganisationen wie Amnesty International oder Human Rights Watch weisen seit Jahren auf die Risiken autonomer Waffensysteme hin, nachdem sie in den vergangenen Jahren beobachten konnten, wie bewaffnete Drohneneinsätze gegen Menschenrechte und humanitäres Völkerrecht verstießen. Daher wurde schon 2013 die internationale Kampagne "Stop Killer Robots" gegründet, um die Öffentlichkeit über die Risiken autonomer Waffensysteme zu informieren und internationale Regelungen herbeizuführen.

In der internationalen Diskussion gibt es eine sehr optimistische Position, die im Vertrauen auf die Entwicklung künstlicher Intelligenz davon ausgeht, dass autonome Waffensysteme die Regeln des humanitären Völkerrechts besser einhalten würden als Menschen – zumal sich menschliche Entscheidungen diesbezüglich immer wieder als unzulänglich erwiesen haben. Andere lehnen Regelungen für Waffensysteme mit der Begründung ab, dass noch niemand genau wisse, wie sie zu definieren seien.

Amnesty International, zahlreiche weitere zivilgesellschaftliche Organisationen und einige Staaten teilen diesen Optimismus nicht. Sie sehen dringenden Handlungsbedarf für ein globales vorsorgliches Verbot von tödlichen und "weniger tödlichen" autonomen Waffensystemen. Sie bezweifeln, dass autonome Waffensysteme die Grundprinzipien der Menschenrechte und des humanitären Völkerrechts überhaupt einhalten können. Die Übernahme menschlicher Verantwortung und Rechenschaftspflicht wären dann nicht mehr möglich.

Damit wären solche autonomen Waffen aus sich heraus unethisch, sie stünden im Widerspruch zum humanitären Völkerrecht und müssten daher verboten werden. Aus Sicht von Amnesty stellen autonome Waffensysteme außerdem eine fundamentale Herausforderung für das internationale Menschenrechtssystem dar, weil sie die Menschenwürde, das Recht auf Leben und das Recht auf körperliche Unversehrtheit nicht angemessen achten würden. Die wichtigste Forderung bleibt deshalb die Einführung eines präventiven Verbots von Entwicklung, Transfer, Stationierung und Verwendung von tödlichen und weniger tödlichen autonomen Waffensystemen. Die Diskussion darf nicht auf die militärische Nutzung und das humanitäre Völkerrecht beschränkt bleiben, auch menschenrechtliche Implikationen von autonomen Waffensystemen müssen berücksichtigt werden.

Mathias John ist Sprecher der Koordinationsgruppe Rüstung, Wirtschaft und Menschenrechte von Amnesty Deutschland. Seit 2015 ist er im ehrenamtlichen Amnesty-Vorstand zuständig für die Länder- und Themenarbeit der deutschen Sektion.