Unscan My Face: Warum wir ein Verbot von Gesichtserkennung brauchen

Mit der Kampagne #UnscanMyFace setzt sich Amnesty International für ein Verbot der Herstellung, des Einsatzes und des Exports von Gesichtserkennungstechnologie in Deutschland, der EU und weltweit ein.

#UnscanMyFace - Behalte dein Gesicht!

Was ist biometrische Gesichtserkennung?

Gesichtserkennung ist eine Form der biometrischen Erkennung. Kameras scannen das Gesicht einer Person. Die Aufnahmen werden mit Hilfe von Computerprogrammen genau vermessen. So wird beispielsweise exakt erfasst, wie weit die Augenbrauen auseinander liegen. Mit Hilfe einer Datenbank werden die Ergebnisse abgeglichen. Da jedes Gesicht einzigartig ist, kann mit Hilfe dieser spezifischen Messungen eine Person erkannt werden Zumindest in der Theorie: die Technologie ist sehr fehleranfällig und funktioniert nicht bei allen Personen gleich gut.

Durch Gesichtserkennung können Aufnahmen 1:1 verifiziert werden, genau genommen: Ist das die Person, die sie vorgibt, zu sein? Das passiert zum Beispiel bei der automatisierten Passkontrolle am Flughafen oder wenn ein Handy mit dem Gesicht entsperrt wird.

Gesichtserkennung kann aber auch für einen Abgleich "1:viele" eingesetzt werden, um zu beantworten: Wer ist diese Person? Gerade dieser Einsatz hat weitreichende Konsequenzen für die Menschenrechte.

Die Verhandlungen gehen weiter - und wir bleiben dran.

Es braucht ein Verbot von Gesichtserkennungstechnologie weltweit – und damit auch in Deutschland und der EU. Tausende Unterstützer*innen haben das EU-Parlament dazu aufgefordert, sich für ein Verbot einzusetzen. Und tatsächlich: Das Parlament hat bereits in der Vergangenheit für ein Verbot gestimmt. Jetzt gehen die Verhandlungen weiter. Parlament, EU-Mitgliedsstaaten und Kommission werden gemeinsam entscheiden - wir bleiben dran.

5 Gründe für ein Verbot von Gesichtserkennungstechnologie

1. Massenüberwachung im öffentlichen Raum wird ermöglicht

Gesichtserkennungstechnologie kann die Handlungen von allen im öffentlichen Raum ganz genau nachverfolgen, z. B. wo, wann und mit wem sich eine Person aufhält. So verschwindet einer der letzten, anonymen Rückzugsorte. Eine Massenüberwachung aller Menschen ist weder angemessen noch verhältnismäßig.

2. Recht auf Privatsphäre und die Menschenwürde werden verletzt

In mehr und mehr Ländern werden die Gesichter von Menschen in öffentlichen Räumen identifiziert und ihre Bewegungen verfolgt. Unternehmen sammeln ohne Erlaubnis tausende Fotos aus sozialen Netzwerken oder nutzen Gesichtserkennung für Werbezwecke. Handlungen werden im Detail erfasst und Menschen auf Datenpunkte reduziert.

3. Recht auf Protest und freie Meinungsäußerung werden verletzt

Wer befürchten muss, auf einer Demonstration identifiziert zu werden, nimmt möglicherweise nicht daran teil. Durch das Wissen, ständig überwacht zu werden, scheuen sich viele Menschen davor, ihre Menschenrechte auszuüben. Das gilt verstärkt für Menschen, die ohnehin von Ausgrenzung und Diskriminierung betroffen sind.

4. Diskriminierungen werden verstärkt

Bei Schwarzen Menschen und People of Colour sowie Frauen und Kindern ist Gesichtserkennung besonders fehlerhaft. Negative Folgen wie Falschverdächtigungen treffen also Menschen besonders hart, die ohnehin Benachteiligungen erfahren. Selbst wenn die Technologie fehlerfrei funktionieren würde: Gesichtserkennung wird verstärkt für die Überwachung bereits marginalisierter Gruppen eingesetzt und verschärft so bestehende Ungerechtigkeiten und Diskriminierungsformen wie Rassismus, Sexismus und Klassismus.

5. Der Einsatz von Gesichtserkennung ist rechtlich zweifelhaft

Für den Einsatz von Gesichtserkennungstechnologie gibt es keine klare rechtliche Grundlage. Datenschutzbehörden und Expert*innen aus ganz Europa warnen: Der derzeitige Einsatz ist illegal. Trotz der rechtlichen Unklarheit wird Gesichtserkennung stückchenweise eingeführt. Um dieser Praxis einen Riegel vorzuschieben, braucht es ein ausdrückliches Verbot.

Menschenrechtsverletzungen durch Gesichtserkennung

10 Beispiele, warum eine weltweite Gefahr gebannt werden muss

Die Massenüberwachung des öffentlichen Raums durch Gesichtserkennungstechnologie ist weltweit ein wachsendes Problem. Die Recherchen von Amnesty International in verschiedenen Ländern haben gezeigt: Durch den Einsatz von Gesichtserkennungstechnologie zur Massenüberwachung wird Menschen die Möglichkeit genommen, sich frei und unbeobachtet im öffentlichen Raum zu bewegen, ihrer Menschenrechtsarbeit nachzugehen oder an Protesten teilzunehmen. 10 Beispiele aus aller Welt belegen: Dieser Einsatz muss verboten werden. In der EU gibt es dafür jetzt eine Chance: Denn gerade wird in Brüssel ein neues Gesetz verhandelt, das über den künftigen Einsatz dieser Technologie entscheidet.

Menschenrechtsverletzungen durch Gesichtserkennung weltweit

© Amnesty International

Biometrische Gesichtserkennung ist in Brasilien weit verbreitet. Die KI-gesteuerte Überwachungstechnik scannt bereits Gesichter bei Karnevals-Veranstaltungen oder in der U-Bahn. An zahlreichen Schulen kontrolliert die Technologie sogar die Anwesenheit der Schüler*innen. Insbesondere Schwarze Menschen werden durch den Einsatz von Gesichtserkennungstechnologie immer wieder falsch identifiziert. Die Folge: Sie werden zu Unrecht beschuldigt, Straftaten begangen zu haben, und verhaftet. Nach Recherchen von O Panóptico waren 90 Prozent der Personen, die aufgrund von Gesichtserkennung verhaftet wurden, Schwarz. Bestehende Diskriminierungen und rassistische Polizeigewalt werden also durch den Einsatz von Gesichtserkennungstechnologie verschärft. Recherchen von Amnesty International zeigen, dass die brasilianische Polizei 2021 6.145 Menschen tötete – über 84 Prozent von ihnen waren Schwarz.

Der weitverbreitete Einsatz könnte jedoch bald eingeschränkt werden. Ein aktueller Gesetzesentwurf sieht ein Verbot der Gesichtserkennungstechnologie im öffentlichen Raum vor – mit Ausnahmen in der Strafverfolgung oder für die Suche nach vermissten Personen.

Lies hier mehr:

China verfügt über ein weites Netz von Überwachungskameras, die mit Gesichtserkennung ausgestattet sind. Über 500 Millionen Kameras sind es laut Medienberichten. Sie sind auch ein Baustein der umfassenden Unterdrückung der Uigur*innen sowie anderer ethnischer Gruppen. Chinesische Wissenschaftler*innen publizierten staatlich finanzierte Untersuchungen zu den Fähigkeiten von Gesichtserkennungstechnologie, Menschen anhand ihrer ethnischen Zugehörigkeit zu kategorisieren. Berichten zufolge bewarb der chinesische Hersteller Hikvision seine Kameras damit, dass sie zwischen

Uigur*innen und Han-Chines*innen unterscheiden könnten. Aber auch europäische Unternehmen verkaufen Gesichtserkennungstechnologie nach China und riskieren damit, dass diese dort zu schweren Menschenrechtsverletzungen beiträgt. Das deckte der Amnesty-Bericht "Out of Control: Failing EU laws for digital surveillance export" auf.

Lies hier mehr:

In einem einjährigen Pilotprojekt wurden 2017-2018 am Berliner Südkreuz in einer Kooperation von Bundespolizei und Deutscher Bahn drei Systeme zur Echtzeit-Gesichtserkennung erprobt. Die Systeme sollten bestimmte Personen aus einer Datenbank in der Masse erkennen. Dabei lag die durchschnittliche Trefferquote der besten Technologie lediglich bei 68,5 Prozent. Das schwächste System hatte sogar nur eine durchschnittliche Trefferquote von 31,7 Prozent. Bei einem realen Einsatz wären daher zahlreiche Menschen zu Unrecht ins Visier der Behörden geraten. Das deutsche Pilotprojekt zeigt, wie fehleranfällig Gesichtserkennungstechnologien sind. Ungenügender Datenschutz führte außerdem dazu, dass das Gesicht eines Probanden ohne seine Zustimmung in der Tagesschau ausgestrahlt wurde. Nach Aussage der Datenschutzbehörden des Bundes und der Länder gab es zudem keine hinreichende rechtliche Grundlage: "Ein Einsatz der Videoüberwachung mit Gesichtserkennung darf daher auf derzeitiger Grundlage auch im Rahmen eines Pilotbetriebs nicht erfolgen", so ihre Schlussfolgerung.

Lies hier mehr:

Am 31. Januar 2023 wurde ein Gesetzesentwurf im französischen Senat gebilligt, der ein flächendeckendes KI-gesteuerte Videosystem zur Massenüberwachung während der Olympischen Spiele 2024 in Paris vorsieht. Wird das Gesetz verabschiedet, wäre dies ein Dammbruch: Erstmals würde ein groß angelegter Einsatz von KI-gesteuerter Massenüberwachung in Frankreich und in der Europäischen Union legalisiert. Millionen Menschen wären von der gigantischen Überwachungsstruktur betroffen. Darüber hinaus besteht die Gefahr, dass das Gesetz durch den Ausbau der Überwachungseinrichtungen die Befugnisse der französischen Polizei dauerhaft erweitert und einer permanenten unverhältnismäßigen Überwachung Vorschub leistet.

Lies hier mehr:

In der indischen Megastadt Hyderabad ist es fast unmöglich, eine Straße entlangzugehen, ohne Gesichtserkennungstechnologie ausgesetzt zu sein. Hyderabad ist eine der am stärksten überwachten Städte der Welt. Das neu errichtete "Command and Control Center" (CCC) der Stadt ist eine Überwachungszentrale, welche die 600 000 Kameras der Stadt in Echtzeit verbindet und auch eine weitere halbe Millionen Kameras im umgebenden Bundesstaat Telangana einbezieht. Ein Gesetz, das Menschen vor Missbrauch der Technologie schützt, gibt es nicht. Besonders gefährdet sind Angehörige von in Indien marginalisierten Gruppen, etwa Muslime, Dalits, Adivasis und Angehörige der LGBTIQ-Communities. Amnesty entdeckte Videos, die Dutzende Fälle zeigen, in denen die Polizei Passant*innen grundlos anhalten und auffordern, ihre Masken abzusetzen, um ihre Gesichter zu fotografieren und Fingerabdrücke zu nehmen.

Lies hier mehr:

Im Iran überwachen Kameras mit Gesichtserkennung, ob Frauen entsprechend des verpflichtenden Kleidungsvorschriften bekleidet sind. Das betrifft auch das Tragen des Kopftuchs. Iranische Personalausweise verfügen über biometrische Fotos, was den Behörden die Identifikation von Personen aus Videos erleichtert. Die Kameras werden an Straßen und Plätzen installiert und sollen unverschleierte Frauen automatisch erkennen. Diese erhalten dann eine SMS mit einer Warnung, dass sie gegen die Vorschriften verstoßen hätten, und einer Strafandrohung. Nach Berichten von Oppositionsmedien sollen zusätzlich Aufnahmen von Verkehrskameras mit anderen Behörden geteilt und genutzt werden, um unverschleierte Frauen zu identifizieren – oder Fahrer*innen, die sie mitnehmen: Wer eine unverschleierte Frau im Auto mitnimmt, riskiert die Beschlagnahmung des Wagens. Auch der Zugang zu Schulen, Universitäten, anderen öffentlichen Gebäuden und öffentlichen Verkehrsmitteln soll verweigert werden, wenn eine Frau kein Kopftuch trägt. Außerdem können Betreibern von Restaurants oder Geschäften die Lizenzen entzogen werden, wenn in ihnen Frauen ohne Kopftuch bedient werden. Offiziellen Angaben zufolge wurden auf dieser Grundlage bereits hunderte Geschäfte im gesamten Land geschlossen.

Lies hier mehr:

Im israelisch kontrollierten Teil der Stadt Hebron (H2) überwacht Gesichtserkennung Palästinenser*innen, die sich in der Stadt bewegen. Das System "Red Wolf" macht hierfür an Checkpoints Fotos ohne ihre Zustimmung, ohne jeden Verdacht und ohne Informationen darüber, welche Daten zu welchen Zwecken erhoben werden. Außerdem werden Fotos für die zugrundeliegende Datenbank "Wolf Pack" auch durch anlasslose Identititätsprüfungen auf der Straße und Hausdurchsuchungen erhoben. Überwacht werden durch die Systeme nur Palästinenser*innen, nicht israelische Siedler*innen oder Menschen anderer Nationalitäten. Die israelische Nichtregierungsorganisation Breaking The Silence beschreibt das System als "eine neue Ebene der Massenüberwachung, weil es Jeden jederzeit überwacht." Sie berichtet von Wettbewerben, bei denen es für das Sammeln der meisten Fotos Preise gebe. In Ost-Jerusalem ermöglicht das Überwachungssystem "Mabat 2000" eine anlasslose Überwachung des palästinensischen Alltags und der Identifikation von Menschen, die an friedlichen Protesten teilnehmen.

Lies hier mehr:

In Russland werden immer wieder friedlich Protestierende mit Hilfe von Gesichtserkennung identifiziert, festgenommen und mit Schikanen überzogen. Selbst Journalist*innen, die nur vor Ort über Proteste berichteten, wurden festgenommen. "Früher war das Risiko vor allem, bei einer Demonstration verprügelt oder festgenommen zu werden. Nun kann man sich nicht mal mehr sicher fühlen, wenn das nicht passiert ist – der Staat weiß, wer du bist und kann jederzeit zuschlagen", so Natalia Zviagina, Direktorin von Amnesty Internationals Moskau-Büro. "Wir wiederholen unsere Forderung, die Identifikation durch Gesichtserkennungstechnologien zu verbieten. Die Verfolgung von friedlichem Protest durch die Behörden hat in Russland durch sie eine ganz neue Dimension erreicht."

Lies hier mehr:

Im Rahmen der Wahlen 2018 legte Simbabwe eine umfassende Datenbank mit biometrischen Daten aller Wähler*innen an, darunter Fotos, Fingerabdrücke und Anschriften. Doch weil die Datensicherheit nicht gewährleistet wurde, gelangten Unbefugte an die sensiblen Daten. Derzeit wird in Simbabwe erneut eine Datenbank mit biometrischen Merkmalen angelegt. Mithilfe des chinesischen Unternehmens "Cloud Walk" werden Gesichter und körperliche Merkmale erfasst und ein nationales Gesichtserkennungsprogramm umgesetzt. Die Überwachungstechnologie soll künftig an Flughäfen, Bahnhöfen und Busstationen zum Einsatz kommen. Es besteht die Gefahr, dass das Kooperationsprojekt der simbabwischen Regierung mit "CloudWalk" in ein umfassendes staatliches Massenüberwachungssystem mündet.

Lies hier mehr:

- Bericht von Algorithmwatch, Identity-management and citizen scoring in Ghana, Rwanda, Tunisia, Uganda, Zimbabwe and China, Oktober 2019; sueddeutsche.de/kultur/gesichtserkennung-die-anonymitaet-der-zebrafinken-1.4993828.

New York City ist voller Kameras – doch in Vierteln wie der Bronx, Brooklyn oder Queens sind es besonders viele. Orte, an denen besonders viele Schwarze Menschen wohnen, werden intensiver überwacht und die Bewohner*innen sind infolgedessen häufiger diskriminierender Polizeiarbeit ausgesetzt. Zu diesem Ergebnis kam eine Untersuchung, die Amnesty International mit mehreren Partnerorganisationen durchgeführt hat. In der Bronx, in Brooklyn und in Queens zeigte die Untersuchung außerdem, dass die Dichte an Überwachungskameras, die mit Gesichtserkennung kompatibel sind, umso höher ist, je höher der Anteil nicht-weißer Einwohner*innen ist. Allein im Zeitraum zwischen 2016 und 2019 setzte das NY Police Department in mindestens 22.000 Fällen Gesichtserkennungstechnologien ein.

Lies hier mehr:

FAQ - Die meistgestellten Fragen zum Thema Gesichtserkennung

Durch den Einsatz von Gesichtserkennungstechnologie werden zahlreiche Menschenrechte verletzt. So beispielsweise das Recht auf Privatsphäre, das Recht auf Nicht-Diskriminierung sowie das Recht, zu protestieren und die eigene Meinung frei zu äußern.

Amnesty International fordert ein Verbot der Herstellung, des Einsatzes und Exports von Gesichtserkennungstechnologie in Deutschland, der EU und weltweit.

Auf EU-Ebene laufen aktuell Verhandlungen zur Regulierung von Künstlicher Intelligenz ("EU AI Act"). Das ist eine einmalige Chance, um den Einsatz von Gesichtserkennung gänzlich zu verbieten. Mit der aktuellen Bundesregierung, die sich im Koalitionsvertrag auf ein europarechtliches Verbot von biometrischer Gesichtserkennung im öffentlichen Raum geeinigt hat, sitzt im Europäischen Rat eine gewichtige Stimme für ein Verbot. Doch auch die Befürworter*innen haben einen sehr starken Rückhalt. In den Verhandlungen wird nun entschieden, wie es um unsere Rechte in Zukunft bestellt sein wird.

Sowohl der Einsatz von wie auch der Handel mit biometrischer Technologie nimmt weltweit zu. Europaweit nutzen mindestens 11 Staaten Gesichtserkennung, und weitere 8 planen dessen Einführung. In Deutschland sollte eine anlasslose Überwachung durch Gesichtserkennungstechnologie an über 100 Bahnhöfen und Flughäfen eingesetzt werden. Nach großem Widerstand wegen des enormen Menschenrechtsrisikos wurde Gesichtserkennung 2020 jedoch vorerst gestoppt. Doch ein allgemeines Verbot dieser Technologie gibt es bislang nicht und Gesichtserkennungstechnologie wird in anderen Zusammenhängen eingesetzt: Das Bundeskriminalamt, die Landeskriminalämter und die Bundespolizei verwenden Gesichtserkennung zur nachträglichen Identifizierung von Personen. Die Datenbank an Bildern, die die Polizei zum Abgleich nutzt, wächst ständig und wird immer häufiger genutzt.

Bei den Verhandlungen in Brüssel werden derzeit neue Regeln für den Einsatz von künstlicher Intelligenz verhandelt. Mit der "KI-Verordnung" entscheidet sich, ob der Einsatz von KI in der EU den Menschen nützt oder ihre Menschenrechte gefährdet. Das Problem besteht darin, dass für Geflüchtete bisher kaum Schutz vor KI-Anwendungen vorgesehen ist. Stattdessen sollen große Migrations-IT-Datenbanken sogar explizit ausgenommen werden. Schon jetzt wird KI an Grenzen eingesetzt. Neue Technologien werden oft an denen getestet, die sich schwerer dagegen wehren können und bereits marginalisiert sind. Aktuell werden bereits Drohnen, Gesichtserkennung, pseudo-wissenschaftlich "Lügendetektoren" oder KI-gestützte Entscheidungen darüber, wer eine Grenze passieren darf, getestet. Das ist diskriminierend. Grenzen dürfen kein Raum ohne Rechte sein.

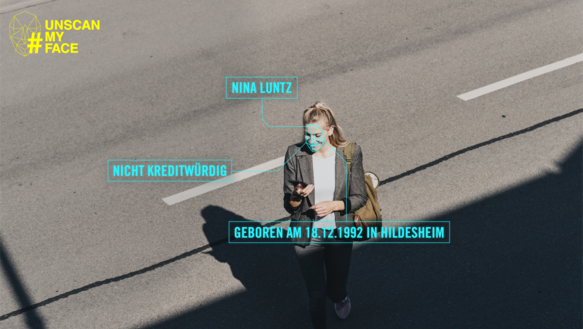

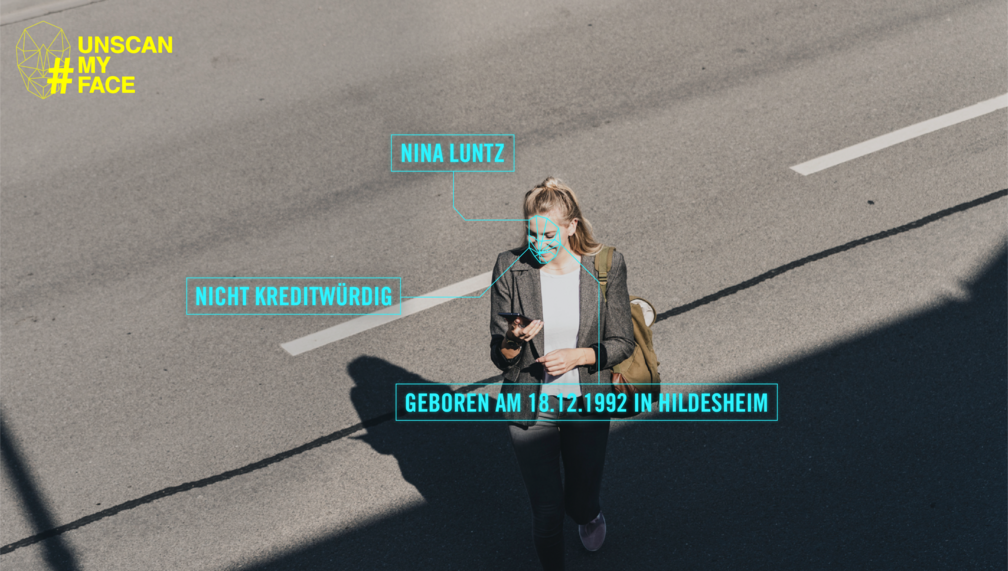

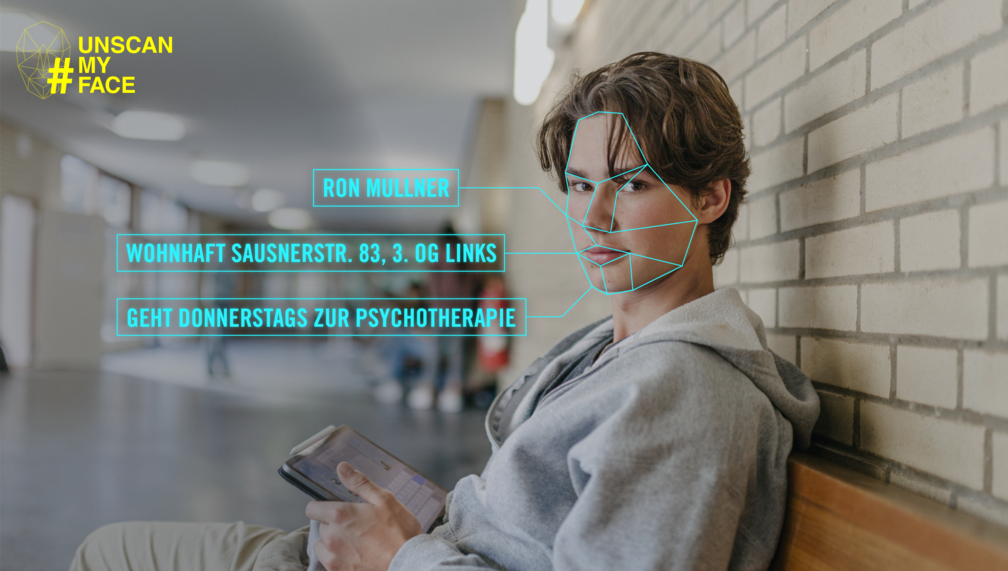

So könnte die Realität mit Gesichtserkennung aussehen

Diese Bilder zeigen Beispiele, die der Illustration dienen. Die Identitäten und Eigenschaften der Personen sind fiktiv.

Was kannst du gegen Gesichtserkennung tun?

Gemeinsam gegen Gesichtserkennung – Jetzt mitmachen!

-

Nutze unseren Kampagnen-Hashtag #UnscanMyFace in den Sozialen Medien, damit mehr Menschen von dem Problem erfahren. Teile deine Gedanken. Warum setzt du dich für ein Verbot ein?

-

Teile unsere Beiträge auf Twitter, Instagram und Facebook.

-

Teile unsere Kampagnen-Seite, damit möglichst viele Menschen von dem Problem um Gesichtserkennung erfahren.

-

Hilf dabei, das Problem in die Öffentlichkeit zu tragen: Sprich mit deiner Familie, deinen Bekannten und Freund*innen. Oder nutze deine Social Media-Kanäle, um das Problem bekannter zu machen.

Gemeinsam können wir Politiker*innen in Deutschland und der EU klar machen: Wir wollen in einer Welt leben, in der Technologie den Menschen nutzt und ihre Rechte geachtet werden.

Ist Gesichtserkennung mit den Menschenrechten vereinbar? Auszüge aus der Allgemeine Erklärung der Menschenrechte:

Niemand darf willkürlichen Eingriffen in sein Privatleben, seine Familie, seine Wohnung und seinen Schriftverkehr oder Beeinträchtigungen seiner Ehre und seines Rufes ausgesetzt werden. Jeder hat Anspruch auf rechtlichen Schutz gegen solche Eingriffe oder Beeinträchtigungen.

Alle Menschen sind vor dem Gesetz gleich und haben ohne Unterschied Anspruch auf gleichen Schutz durch das Gesetz. Alle haben Anspruch auf gleichen Schutz gegen jede Diskriminierung, die gegen diese Erklärung verstößt, und gegen jede Aufhetzung zu einer derartigen Diskriminierung.

Jeder hat das Recht auf Meinungsfreiheit und freie Meinungsäußerung; dieses Recht schließt die Freiheit ein, Meinungen ungehindert anzuhängen sowie über Medien jeder Art und ohne Rücksicht auf Grenzen Informationen und Gedankengut zu suchen, zu empfangen und zu verbreiten.

1. Alle Menschen haben das Recht, sich friedlich zu versammeln und zu Vereinigungen zusammenzuschließen.

2. Niemand darf gezwungen werden, einer Vereinigung anzugehören.

Der Einsatz von Gesichtserkennungstechnologie kann Menschen davon abhalten, demonstrieren zu gehen:

#unteilbar-Demonstration in Berlin am 4. September 2021

© Amnesty International, Foto: Jarek Godlewski

Offener Brief an die deutsche Bundesregierung: Jetzt für Verbot von Gesichtserkennung in der EU einsetzen!

24 zivilgesellschaftliche Organisationen, darunter auch Amnesty International, haben einen offenen Brief an die Mitglieder der deutschen Bundesregierung verfasst. Die Bundesregierung muss ihren Worten nun Taten folgen lassen und sich bei den aktuellen Verhandlungen zur europäischen Verordnung über Künstliche Intelligenz (KI-Verordnung) für ein umfassendes Verbot von Gesichtserkennungstechnologie einsetzen. Lies hier den offenen Brief.

Eine Hauswand mit dutzenden Überwachungskameras

© Vicente Mendez

Weiterführende Informationen bei unseren Partnern

Noch mehr Informationen erhältst du auf folgenden Websites:

Jetzt weiter für Verbot stark machen

Es braucht ein Verbot von Gesichtserkennungstechnologie weltweit – und damit auch in Deutschland und der EU. Tausende Unterstützer*innen haben das EU-Parlament dazu aufgefordert, sich für ein Verbot einzusetzen. Und tatsächlich: Das Parlament hat bereits in der Vergangenheit für ein Verbot gestimmt.

Auch in Deutschland wird weiterhin über den Einsatz von Gesichtserkennungstechnologie im öffentlichen Raum verhandelt. Im Bündnis mit vielen weiteren Organisationen sagen wir: Der Einsatz von Gesichtserkennung im öffentlichen Raum ist mit den Menschenrechten unvereinbar. Hier kannst du eine E-Mail an die eingebundenen Abgeordneten schicken, die Achtung der Menschenrechte einfordern und so die aktuellen Verhandlungen beeinflussen.

Wie wichtig es ist, dass zahlreiche Organisation und Bündnisse jetzt am Ball bleiben, zeigen die großen Versäumnisse bei der Achtung von Rechten von Menschen auf der Flucht: In den Verhandlungen müssen EU-Abgeordnete sich endlich für eine KI-Regulierung einsetzen, die die Menschenrechte von Geflüchteten schützt.